文|巴比特资讯

AI 驱动的图像生成正在蓬勃发展,这是有充分理由的:它有趣且易于使用。虽然这些模型带来了新的创意可能性,但它们可能会引起人们对不良行为者潜在滥用的担忧,这些不良行为者可能会故意生成图像来欺骗人们。即使是为了好玩而创作的图像也可能会像病毒一样传播并可能误导人们。

例如,今年早些时候,教皇方济各穿着一件华丽的白色蓬松夹克的图片在网上疯传,特朗普被逮捕的照片引发热议。这些图像不是真实的照片,但很多人都被愚弄了,因为没有任何明确的指标来区分这些内容是由生成式 AI 创建的。

Meta 研究人员近日发布了一篇新的研究论文和技术代码,详细介绍了一种为 AI 图片添加隐形水印的技术,用于区分开源生成式 AI 模型何时创建的图像。隐形水印将信息合并到数字内容中。这些水印肉眼看不见,但可以通过算法检测到——即使人们重新编辑了图像。虽然围绕水印还有其他研究方向,但许多现有方法在生成 AI 图像后创建水印。

据 Everypixel Journal 报道,用户已经使用三个开源存储库的模型创建了超过 110 亿张图像。在这种情况下,只需删除生成水印的行即可删除不可见水印。Stable Signature 提出了一种方法来避免水印被删除。

01、Stable Signature 方法的工作原理

论文地址:

https://arxiv.org/abs/2303.15435

Github 地址:

https://github.com/facebookresearch/stable_signature

Stable Signature 通过将水印扎根于模型中,并使用可追溯到图像创建位置的水印,消除了删除水印的可能性。

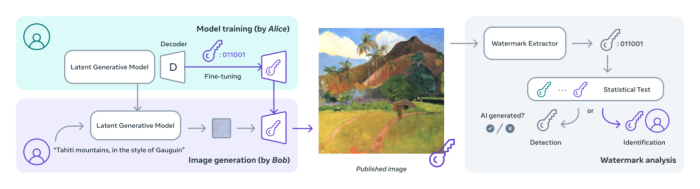

让我们通过下面的图表来看看这个过程是如何工作的。

Alice 训练了一个主生成模型。在分发之前,她对模型的一小部分(称为解码器)进行了微调,从而为 Bob 生成给定的水印。该水印可以标识型号版本、公司、用户等。

Bob 收到他的模型版本并生成图像。生成的图像将带有 Bob 的水印。Alice 或第三方可以对它们进行分析,看看图像是否是由使用生成式 AI 模型的 Bob 生成的。

这通过两步来实现:

1. 联合训练两个卷积神经网络。一种将图像和随机消息编码为水印图像,另一种则从水印图像的增强版本中提取消息。目标是使编码和提取的消息匹配。训练后,只保留水印提取器。

2. 对生成模型的潜在解码器进行微调以生成包含固定签名的图像。在此微调过程中,会对批量图像进行编码、解码和优化,以最大限度地减少提取的消息与目标消息之间的差异,并保持感知图像质量。这种优化过程快速有效,只需要小批量和很短的时间即可获得高质量的结果。

02、评估 Stable Signature 的性能

我们知道人们喜欢分享和转发图像。如果 Bob 与 10 个朋友分享了他创建的图像,然后每个朋友又与另外 10 个朋友分享了该图像,结果会怎样?在此期间,有人可能会更改图像,例如裁剪、压缩或更改颜色。研究人员构建了Stable Signature以应对这些变化。无论人们如何转换图像,原始水印都可能保留在数字数据中,并且可以追溯到创建它的生成模型。

研究人员发现 Stable Signature 相对于被动检测方法的两大优势:

首先,能够控制和减少误报的产生,当将人类生成的图像误认为是 AI 生成的图像时,就会发生误报。考虑到在线共享的非 AI 生成图像的盛行,这一点至关重要。例如,最有效的现有检测方法可以发现大约 50% 的编辑生成图像,但仍会产生大约 1/100 的误报率。换句话说,在每天接收 10 亿张图像的用户生成内容平台上,大约 1000 万张图像将被错误标记,从而仅检测到一半的 AI 生成图像。

另一方面,Stable Signature 以 1e-10 的误报率(可以设置为特定的期望值)以相同的精度检测图像。此外,这种水印方法允许追踪同一模型的不同版本的图像——这是被动技术无法实现的能力。

03、如果一个大模型经过了微调,Stable Signature 如何检测到微调版本生成的图像?

AI 大模型的一种常见做法是采用基础模型并对其进行微调,以处理有时甚至为一个人量身定制的特定用例。例如,可以向模型显示 Alice 的狗的图像,然后 Alice 可以要求模型生成她的狗在海滩的图像。这是通过 DreamBooth、Textual Inversion 和 ControlNet 等方法完成的。这些方法作用于潜在模型级别,并且不会更改解码器。这意味着我们的水印方法不受这些微调的影响。

总体而言,Stable Signature 与矢量量化图像建模(如 VQGAN)和潜在扩散模型(如 Stable Diffusion)配合良好。由于这种方法不修改扩散生成过程,因此它与上述流行模型兼容。通过一些调整,稳定签名也可以应用于其他建模方法。

04、AI 水印真的靠谱吗?

通过添加隐形水印的方式来识别 AI 生成图像的技术最近受到很多争议。Google DeepMind 最近宣布针对图像生成推出一种添加水印的工具 SynthID,同时识别 AI 生成的图像。通过扫描图像中的数字水印,SynthID 可以评估图像是由 Imagen 模型生成的可能性。

但 AI 水印是否能够被轻易去除?据外媒 Engadget、Wired 等报道,美国马里兰大学的一个研究小组对 AI 生成内容的“数字水印”技术可靠性进行研究,发现这一技术可被轻易破解。

该校计算机科学教授 Soheil Feizi 面对 AI 生成图像的水印现状时直言不讳:“目前我们没有任何可靠的水印技术,我们破解了所有的水印。”

在测试过程中,研究人员可轻松避开现有的水印方法,并发现在非 AI 生成的图像上添加“假水印”更为容易。同时,该团队还开发出了一种“几乎无法”从图像中去除的水印技术,且不会完全损害图像的知识产权。

AI 水印这种方式仍旧不过成熟,并不能成为百分百有效的工具。我们需要期待未来能够出现新的技术来为生成式 AI 图像保驾护航,避免虚假图片泛滥,避免版权侵害。

参考资料:

https://ai.meta.com/blog/stable-signature-watermarking-generative-ai/

评论