文|智东西 ZeR0

编辑|漠影

智东西5月25日报道,和前两年一样,今年微软Build开发者大会再度以虚拟方式举行,并由微软董事长兼CEO萨提亚·纳德拉发表开场演讲。

本届大会的主角是人工智能(AI)、低代码和无代码开发,微软还特别为AI开发者打造了一款外形酷似Mac Mini的全新硬件Project Volterra。

这是一款迷你版台式机,由高通骁龙计算平台提供支持,内置神经网络处理器(NPU),方便开发者构建和执行本地AI加速任务。

微软还进一步降低AI开发和软件开发门槛,不仅公布新的OpenAI服务,允许开发者使用GPT-3自然语言模型的功能,而且着重推出自动转换编程语言、自动补写代码、查错等能力,甚至为其Power Apps平台新增了一项AI快速设计功能,可将手绘草图、图像、文档、设计文件或演示文稿自动转换为工作软件。

此外,为了持续优化远程协作办公,微软在其视频会议软件Microsoft Teams中推出一项实时共享新功能,方便参会者直接在远程会议期间实时地展示3D创作的编辑、创作、更改过程。

合作方面,Meta选择微软Azure作为战略云供应商,将使用Azure的超级计算能力加速AI研究与开发,并将合作扩大PyTorch在Azure上的应用,微软还将继续为PyTorch提供企业级支持。

微软也正与PyTorch和AMD合作,为在Azure上运行PyTorch的客户优化性能和开发者体验。

01 微软首款“台式机”:内置高通骁龙和NPU

微软正在开发Visual Studio 2022的原生Arm版本和迷你版Arm PC。

虽然像Surface Pro X这样的Arm设备已经能够通过x64仿真运行Visual Studio,但一些功能没有得到支持,性能也有所限制。因此很多开发者都对听到更多Arm原生支持抱有期待。

微软正在创建一个全面的Arm原生开发工具链,包括Visual Studio 2022、VC++、.NET和.NET框架的Arm原生版本。微软正在努力支持Open JDK、Python、LLVM、Node和Git作为原生针对Arm64的开源项目。

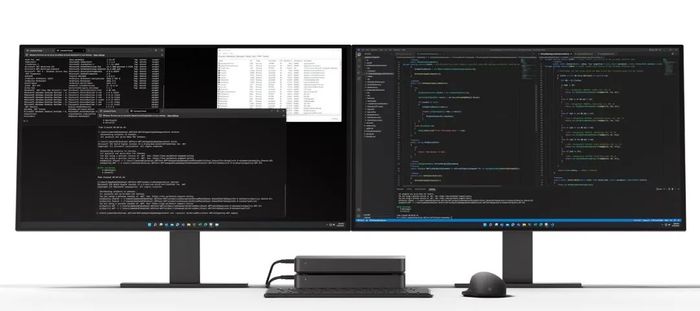

微软还再次与高通合作,打造了一款由Arm驱动的开发者设备Project Volterra。

这款迷你“台式机”外形与Mac Mini相似,拥有可堆叠的设计,开发者可将多台Project Volterra PC堆叠在桌上或服务器机架内。

它内置有高通骁龙处理器、神经处理单元(NPU),适用于Windows的高通神经网络处理SDK工具包,可帮助开发者构建执行本地AI加速工作负载的应用。

Windows开发者能够在他们喜爱的所有生产力工具(包括Visual Studio、Windows Terminal、WSL、VSCode、Microsoft Office和Teams)旁边构建、测试和调试Arm原生应用程序。

这是微软构建智能混合计算世界愿景中的一环。微软希望,未来客户端与云之间的移动计算工作负载,将像今天手机在Wi-Fi和蜂窝网络之间移动一样动态和无缝。为此,微软一直在开发平台支持新兴的硬件平台和技术,包括MIPS、x86、Alpha、Itanium和x64在内的CPU。

微软尚未透露完整的规格,目前仅知Project Volterra由回收的海洋塑料制成,后面有3个USB端口、1个DisplayPort和1个以太网端口,侧面还有2个USB-C端口。微软后续会分享更多内容。

“我们希望您构建云原生AI应用。”Windows和设备负责人Panos Panay说,“使用原生Arm64 Visual Studio,.NET support和Volterra项目将于今年晚些时候到来,我们将发布新的工具,帮助您迈出这一旅程的第一步。”

有趣的是,两年前苹果宣布自家电脑芯片将从英特尔x86处理器向自研Arm处理器过渡时,也发布了开发者过渡套件(DTK),其Mac mini搭载了苹果基于Arm指令集架构研发的A12Z芯片。

去年微软曾在Build大会上宣布与高通合作,为开发者打造了一个基于Arm的开发工具包,以便为Windows构建原生Arm64应用。如今,双方的合作更进一步。我们也期待看到更多Arm驱动的Windows设备和应用。

Visual Studio 2022的原生Arm预览版将在“未来几周内”发布,预计将于今年晚些时候完全发布,同时支持Arm64 .NET。

02 让数十亿人都能开发软件,从即时创建app,到自动翻译代码

基于大模型,微软公布了由顶尖AI研发机构OpenAI打造的AI大模型GPT-3提供支持的首款产品功能——不会编码,也能构建应用程序。

微软企业业务应用程序和平台副总裁Charles Lamanna认为,通过使用AI驱动的开发,从低代码到无代码,数十亿人将能够开发软件。

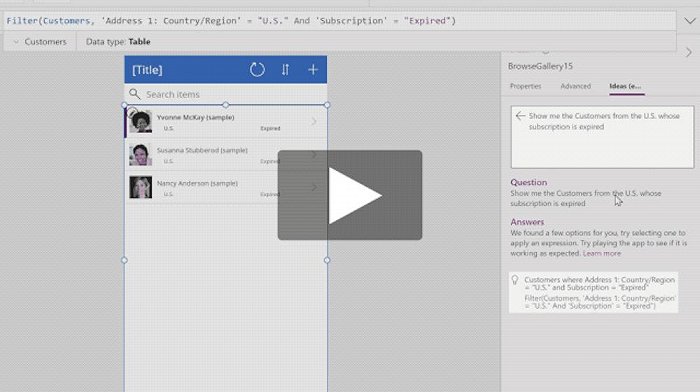

为此,Lamanna团队将GPT-3与微软低代码应用开发平台Microsoft Power Apps集成,用于一项名为Power App Ideas的功能,该功能允许人们在开源编程语言Power Fx中使用对话语言创建应用程序。Power Fx建立在Microsoft Excel上。

通过GPT-3支持的新功能,Microsoft Power Apps用户可以用会话语言描述编程目标,并将其自动转换为Power Fx代码。

无论是几乎没有编码经验的人,还是有深厚编程专业知识的专业开发者,都能借助这一新AI功能提高构建应用程序的效率。

此外,微软在Build大会上公布一项名为Power Apps Express Design的新功能:通过利用Azure认知服务的AI模型,用户只需点击几下,就能直接将纸质表格、PowerPoint、PDF、手绘草图、传统应用程序的UI屏幕截图、Figma专业设计资产等图像和设计文件即时转换为软件应用。

将草图上传至Express Design,即可快速生成可用的app

微软还宣布了其具备自动编程功能的GitHub Copilot和OpenAI Codex的更新:

GitHub Copilot在技术预览中的使用数据以及关于一般可用性的更新。Copilot项目将代码翻译成自然语言描述,可为新手开发者或从事不熟悉的代码库的人提供有效帮助。

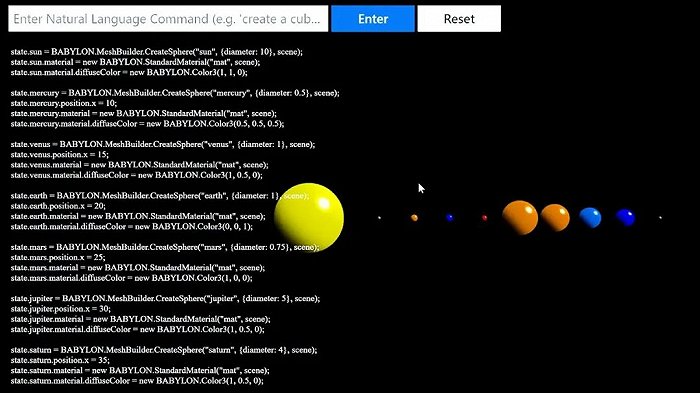

OpenAI Codex源自GPT-3,可将自然语言翻译成十几种编程语言的代码。

例如,在图形渲染引擎Babylon.js中工作的创建者将“创建太阳系模型”输入文本框,AI驱动的软件会将该命令转换为太阳系模型的代码。

微软GitHub与OpenAI合作,将Codex集成到Visual Studio Code等软件开发程序的可下载扩展GitHub Copilot中。

GitHub Copilot使用Codex从开发者的现有代码中提取上下文,可向开发者建议接下来可输入的代码和函数行。开发者还可以用自然语言描述他们想要实现的目标,Copilot将利用其知识库和当前上下文来提供方法或解决方案。

这些演示和相关代码将在GitHub上提供给微软Build的参会者。与会者还可以在3个月内无限制地访问OpenAI的Codex模型。

此外,微软的代码开发和托管平台Power Pages现可预览,低代码制作者和专业开发者可以借助这一平台高效设计、配置和发布桌面和移动网站。Power Pages经过重新设计,已经拥有全新的用户体验和许多新功能。

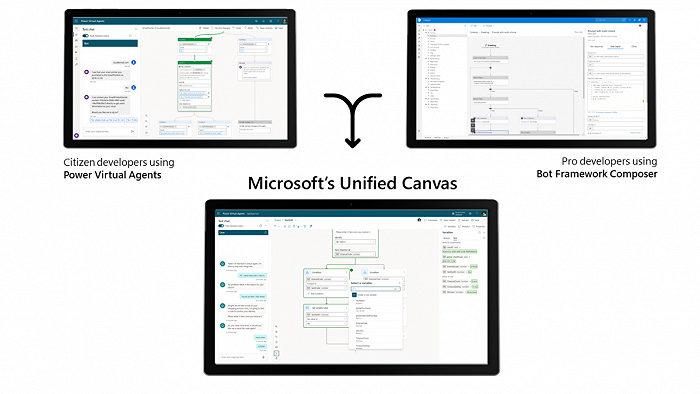

微软还将Azure Bot Framework Composer的专业代码功能的复杂性和Power Virtual Agents低代码平台的简易性进一步整合,方便专业及普通开发者协作构建智能机器人。

根据微软对近1000名商业决策者、用户及潜在用户关于低代码影响的调查,近90%的用户认为低代码对其生产力有积极的影响,83%的用户认为低代码使他们能够自己做一些通常需要开发团队的事情,超过80%的用户认为低码/无码平台提供了一个提高他们开发知识和技术能力的机会。

03 OpenAI服务现可预览,允许访问GPT-3和Codex

微软Azure人工智能为认知服务推出了两项更新。

一个是Azure OpenAI服务,现已可以预览。获批的用户可利用Azure的企业能力访问OpenAI的不同模型,包括GPT-3基础系列(Ada、Babbage、Curie和DaVinci)、Codex系列和嵌入模型。

OpenAI服务能帮助客户为写作辅助、代码生成和理解非结构化数据等用例构建先进的应用。通过微调和内置负责任的AI等功能,客户还可以根据具体需求定制模型,以检测和减少负面的应用。

另一处更新是Azure Cognitive Service for Language服务。该服务可为文档和对话提供总结,帮助开发者快速浮现文档和联络中心电话中的关键信息,例如通话的原因和解决方案。

其他功能包括自定义命名实体识别,用于帮助开发者识别某个领域的特定术语;以及自定义文本分类,以帮助开发者用特定领域标签来组织和分类文本,如发票。

微软Azure机器学习负责任的AI仪表板功能现已进入预览阶段。

该AI仪表板汇集了数据资源管理器、公平性、模型可解释性、错误分析以及反事实和因果推理分析等多种功能,有助于开发者调试他们的模型,从而加速模型部署。

此外,Azure机器学习提供了一个负责任的AI记分卡,以总结模型性能和见解,帮助技术和非技术受众了解应用负责任AI的影响。

04 远程开会,还实时演示3D创作

“临场感是最终级的杀手级应用。”纳德拉说。

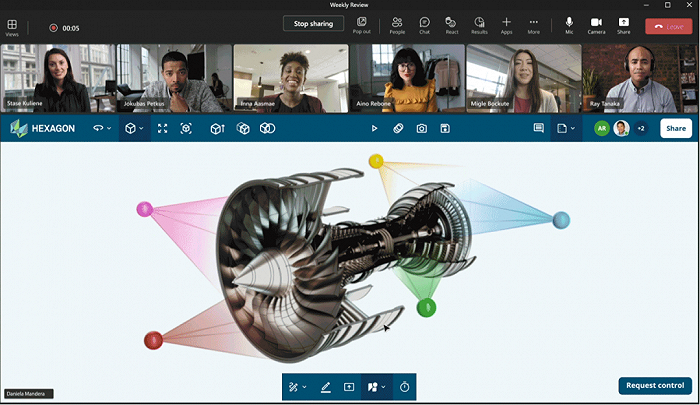

微软正不断为其Microsoft Teams视频会议软件建立更丰富的实时协作体验。最新增加的一个功能是实时共享(Live Share)。

对于具有Live Share功能的应用程序,Team允许参会者共同创建、编辑、注释、放大和缩小以及各种形式地进行共享内容的互动。

比如,Hexagon开发者创建了一个应用原型,在Teams中使用Live Share功能后,参会者可以一边开会,一边放大、注释和编辑3D模型。

微软还在Team中提供白板集成,其中包括与Live Share类似的共同创建和共同编辑体验。

Live Share工具建立在微软Fluid Framework上,只需几行代码,开发者便可借此创建更多共享和交互式服务和应用,微软已将Fluid作为其Loop组件集成到Teams和Outlook中。

05 与Meta合作加速AI与PyTorch应用

微软还宣布了与社交平台巨头Meta、芯片巨头AMD、知名开源平台Hugging Face的重要合作伙伴关系。

Meta选择Azure作为战略云供应商,帮助加速开发者的AI研究和实验。作为协议的一部分,Meta公司将扩大使用Azure的超级计算能力,以加速其Meta人工智能小组的AI研究和开发。

Meta将利用由5400个GPU组成的专用Azure集群,使用Azure中最新的虚拟机(VM)系列(NDm A100 v4系列,采用英伟达A100 Tensor Core 80 GB GPU),用于其一些大规模的AI研究工作负载。

此外,Meta与微软将合作扩大PyTorch在Azure上的应用,并加速开发者从实验到生产的过程。

在未来几个月,微软将建立新的PyTorch开发加速器,以促进在Azure上快速实施基于PyTorch的解决方案。微软还将继续为PyTorch提供企业级支持,使客户和合作伙伴能够在云和边缘的生产中部署PyTorch模型。

因为Azure将是第一个部署AMD旗舰M200 GPU用于大规模AI训练的公共云,微软正与PyTorch和AMD合作,为在Azure上运行PyTorch的客户优化性能和开发者体验,并确保开发者的PyTorch项目在AMD硬件上以最佳方式运行。

面向数据科学家和机器学习从业者的开源平台Hugging Face也将加深与微软的合作,并扩大其Azure的整合。

新的Hugging Face端点服务得到了Azure机器学习的支持,可在Azure市场上使用,将帮助开发人员和数据科学家更快速、更容易地部署成千上万的自定义或预训练的转换模型。

此外,Hugging Face和微软将把Private Model Hub和专家加速计划引入Azure,并使Hugging Face的API直接在Azure机器学习中消费。

06 其他AI更新:增强大规模,管理部署,简化多种开发体验

Azure机器学习的其他更新包括:

(1)Azure机器学习管理端点现在普遍可用,可以帮助开发者和数据科学家更轻松地部署大规模机器学习模型,用于实时和批量推理。

(2)预览版AutoML功能包括对自然语言处理和图像任务的支持、模型训练代码的生成以及对产品集成和机器学习操作(MLOps)的增强。

(3)预览版Python SDK v2简化了开发者的体验,命令行界面v2允许用户无需学习特定的编程语言,即可参与机器学习的生命周期。

面向更具体的行业应用,Azure表单识别器在预览中增加新功能。用户可解锁新的文档处理场景,如利用保险卡和疫苗卡的预建模型简化病人的登记和疫苗验证。此外,针对段落、标题的布局能力使文本提取更加精确。

两名NHS外科医生正在使用Azure AI来发现手术期间面临更大风险的患者

微软智能数据平台现已全面上市,它是一个新的集成平台,将数据库、分析和治理统一起来,使企业能够投入更多时间创造价值,而不是整合和管理零散的数据资产。

微软智能数据平台使企业能够在快速发展的环境中轻松地进行调整,为他们的应用程序增加智能层,释放预测性的洞察力,并在任何地方管理他们的数据。它解决了客户的主要痛点,如市场分散,同时也使客户能够更有效地捕获和利用数据,以增加市场份额。

07 结语:AI和低代码开发正成为微软的杀手锏

此次微软Build大会清晰传递出微软对AI开发、低代码&无代码产品以及协作开发的看重。

作为愈发被公认的生产力工具,AI不止被用于挖掘各行各业的数据价值和提高生产效率,也正驱动软件开发流程的创新与升级。

从微软提供的一系列工具,我们看到由AI驱动的模型和工具,可以帮助开发者清理数据、补写编程代码、转换编程语言、检查代码错误、调试错误,乃至直接将草图手稿转换成即时可用的app。

这些工具和平台,不仅进一步降低了AI与软件开发的门槛,使得开发者、工程师可以跳出一些繁琐的步骤,少掉几根头发,还使其得以将重心放到更有价值的创新工作上来。

评论