文|脑极体

很多读者可能已经从很多地方了解到,提示工程师有多么火爆,市面上也出现了许多高价“卖铲子”的培训班,号称“拿百万年薪”。

而前不久的一个亲身经历,则让我确信,普通人转行“提示工程师”,毫无意义。

事情是这样的。

我前不久去深圳东莞的松山湖风景区,参加了HDC.cloud 2023华为开发者大会。那里平时也有不少市民前去游玩打卡拍照,所以活动现场的展厅和会议室,也来了很多老人和小孩看热闹。

在一个数字人系统的演示屏幕前,一个五六岁的小男孩,就在我们一群大人的旁观下,独立完成了“输入指令、生成视频、播放测试、修改内容”的整套操作。

当然,他第一次接触这套系统,甚至可能是第一次见到数字人,写的提示词粗糙,生成的视频也很短,没什么可看性。但这个事情,给出了“一个比特的信息”,让我们确定,通过自然语言和直观方式与大模型进行交互,认知门槛和操作门槛,正在急速下降。

一个没有受过任何训练的小学生,也可以轻松运用数字人背后的文本、图像、语音等多种模型能力,让它执行特定任务。

这意味着,为生成式AI写提示词,将是未来工作的默认技能,就像今天绝大多数知识岗位要会使用搜索引擎,以前创作者都要懂怎么去图书馆查找资料一样。

真正的“提示工程”,又需要和大模型一起,深入行业和业务场景,而在那里,Prompt对专家的需求度,远高过专家对Prompt的需求度。

所以,普通人转行“提示工程师”,毫无意义,至少赚钱、稳定、门槛低,这三重意义,那很快就不沾边了。

高薪的虚假繁荣

作为大模型浪潮所创造的新职业之一,“提示工程师”之所以最出圈、最令人兴奋,就在于夺人眼球的高薪。

一些招聘薪酬甚至高达335k 美元年薪(相当于人民币230万),为什么呢?因为因为提示词(Prompts),和大模型输出结果的强相关性。

生成式AI需要提示工程师和大模型交互、对接、设计和研发提示词,借助精准的指令或提示词,才能充分释放大模型的生产力。一旦大模型出现“幻觉”和胡说八道,也需要提示工程师再针对性地精调和训练,以确保AIGC达到预期的效果。

听起来,似乎是一项很有挑战性的工作,但需要注意的是,这个“写提示词”的大量中间环节,很快会被两股力量干掉。

一股力量,就是大模型本身。

大模型的本质,就是将智力工作(写PPT绘画写报告等)自动化、工业化,而“写提示词”包括的一系列特殊技能,比如模型功能理解、任务理解、编程、交互创意、测试评估、改进调整,这些中间环节,现阶段可能还需要专门学习、投入大量人力、智力资源来完成,但很快会被废弃,或者封装成开箱即用的插件/应用。

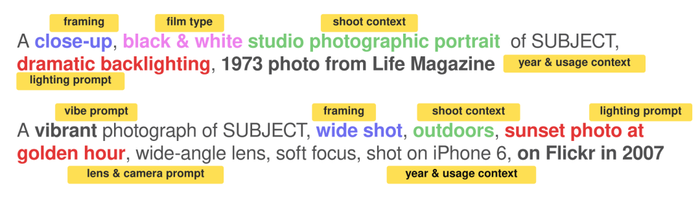

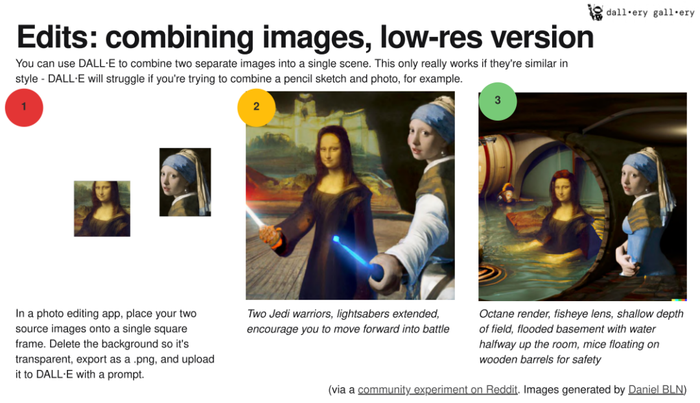

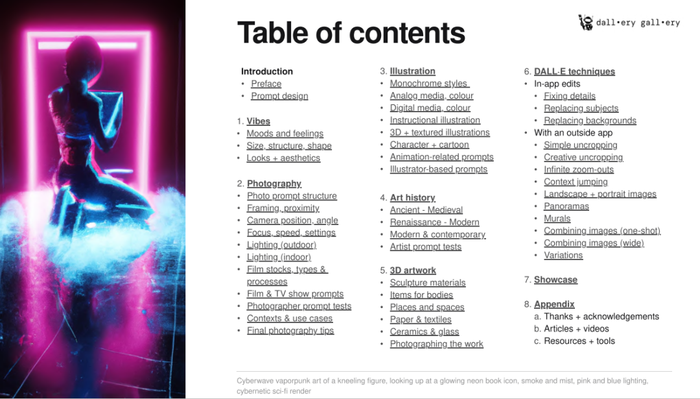

随着大模型变得越来越好,已经出现一大堆插件工具,将“写提示词”这一智力劳动,推进到工业化、自动化阶段。除了前面提到的数字人系统,目前FusionAI也推出了提示词自动生成工具,Stable Diffusion也支持“拖拉拽”选风格,不需要用户自己琢磨,DALL-E 2也有非常精细的Prompt指导手册。所以,这项技能会被大模型变得越来越低门槛。

(详细的AIGC教程)

另一股力量,是开源开放。

开源模式,可以说是对创新的毫无保留,这对降低提示工程的复杂度和难度,起到了非常积极的作用。目前用大模型的门槛已经下降到,只需要一台笔记本电脑甚至一个手机,各个细分领域的从业者都可以探索、创造好用的Prompt,并通过开源社区、社交媒体等渠道开放出去。一些高容错率的场景,比如AI绘画、情感问答,免费优质的Prompt一搜一大把,很难形成付费;而低容错率的场景,比如蛋白质预测与生成,需要深入的业务理解和广泛的技术知识Prompt也不是几周、几个月的培训就能写出来并work的。

电梯刚出现的时候,大部分人不会用、不敢用,还诞生了一个工种叫“电梯操作员”,专门只帮人按电梯。但现在,电梯操作简单到小朋友都会按,我们只会在两种情况见到“电梯操作员”,一种是特殊作业场景,比如医院、高校,替人按电梯只是一份重复且乏味的工作,收入也比较惨淡;另一种则是高端服务场景,比如五星酒店、高级会馆,靠为高净值人群提供服务溢价,大约类似于到烟草集团给“烟草行业大模型”写提示词,确实能实现高薪,但岗位十分稀缺,成功竞争上岗的注定只是少数人。

一边是AI大模型的“大力出奇迹”,一边是开源生态的“人多力量大”,所以,留给 “提示工程师”的高薪岗位,真的没有想象的那么多。

负担重重的稳定

有些人并不是一门心思想赚钱,而是对现有的工作感到非常不安全,想转行到欣欣向荣的AI行业。而算法工程师、产品经理等,都有学历、技术背景、工作经验等的严苛要求,与之相比,“提示工程师”往往不要求有正式的技术学位,对工作年限和经验的要求也相对宽松。

很多担心现有工作岗位被AI取代的人,就希望做“提示工程师”。毕竟连OpenAI首席执行官Sam Altman都说了,提示工程(Prompt Engineering)最终可能会变得不那么重要,但就目前而言,它仍然是一种惊人的高杠杆技能。

但他没有提到的是,IT行业有一个默认的潜规则:所有的软件都是负债(Technical debt)。任何新兴的热门软件、技术应用、开发语言,都是一种技术债务,会不断经历重大升级,很多软件可能会被停用,一些代码会被重写,公司或业务发生变化时,可能就换成了完全不同的技术。这也是为什么程序员会有35岁危机,一方面是职场内卷的结果,另一个原因也是源于随着从业年份增长,技术人员也会背上更多“技术债务”,如果不能及时清零、与时俱进、终身学习,跟不上最新的技术趋势,压力越来越沉重。

提示工程是一门较新的学科,无论是底层的大模型,还是应用层的提示词开发和优化,都有非常多的变数,技术创新迭代会非常快。

计算机专业的从业者,凭借扎实的专业基础、内化的开发意识和审美,或许能够很快迁移到新的技术工具上,跟上变化。

而普通人因为恐惧AI威胁而盲目转行,在短时期内只能掌握一点皮毛,也不一定是发自内心的热爱,一旦技术发生较大的变化,可能投入的学习成本、时间成本、机会成本都会湮灭。所以想当提示工程师的人们,真的做好了“任他雨打风吹,我自岿然不动”的心理准备吗?

真实的入行门槛

当然,时代给普通人的上升机会本就稀少,通过容易上手的“写提示词”技能作为“跳板”,进入行业之后再提升自己,“提示工程师”是非常好的路径。

从可能会被消灭的“写提示词”型工程师,转变成真正掌握了算法优化、开发、落地部署的“提示工程”,那才是成功的转型。

那么,实际操作中,提示工程究竟需要哪些能力呢?

首当其冲的,还是AI技术。

脉脉人才智库的一项调查显示,目前AIGC热招的岗位以技术岗位为主,算法工程师、自然语言处理、图像识别等研发人才;而供给端,热投的岗位则以AI产品经理类、运营类等非技术岗位居多。

人才供需结构的失衡,也说明壁垒较高的技术岗位,对于算法、编程功底、学术研究成果等要求,并没有放松多少,只有少部分人能够胜任。具体到提示工程师,就业市场还没有非常形成明确的标准和规范,所以由技术人员来内部转岗/兼任/探索,恐怕会成为大多数企业的选择。

其次就是要“懂行”。

提示工程要在业务中发挥大模型的生产力价值,这就需要对AI和Prompt有深入了解,同时对业务场景、企业需求、发展战略等很了解,可以将专业术语,直接而精确地用产品逻辑与数学逻辑表达出来,形成更具体的提示工程应用,比如细分到金融文本解析、论文摘要生成、客服话术质量控制等,才能保证输出结果是有业务价值的最佳方案。

也就是说,即使没有计算机或深度学习的学历背景,作为行业专家,也能与算法工程师等配合做好提示工程,未来也可以转型成为AI产品经理。那么问题来了,普通人是否把自己正在干或者真正感兴趣的职业,做精做好,做到专家级别呢?

幻想在另一个赛道重新开始、白手起家、降维打击,那是爽文,不是现实。

同时还要提醒的是,提示工程师的职业风险,也是现实存在的。

众所周知,大模型有不守规矩、胡说八道的“幻觉”问题,可能产生伪造、色情等有害内容,要让大模型的服务可靠可信,必须有人来把关和验证,提示工程师就是AIGC的“守门员”。而很多开源大模型是“不承诺任何责任”的,因为免费开放,所以一旦模型出现问题,比如有后门、遭到攻击等,就很难追责。

怎么办呢?只能是“谁用谁负责”。万一出现了有害内容或不可靠的结果,提示工程师自然也要承担连带责任。

有个段子说,AI取代不了会计,因为AI不能坐牢。解决思路这不就来了,那就是由同样是人的提示工程师,取代会计坐牢啊(并不是说真的会坐牢!)。

去年年底,Meta宣布AI部门拆散重组,原因是不应该有独立的AI部门,AI应该融入到各个业务线当中去。当时,一些AI概念股也开始低迷,在高歌猛进期投身工业界的AI科学家,不少又重返学界。没想到年初ChatGPT炸裂登场,又为AI续了一命。

提到这段并不久远的历史,是希望大众别只看到AI“吃肉”,也得看到“挨打”的一面。AI产业进程中,也存在较大的变数和不确定性,岗位随时会有调整和变化。

大模型热度催生的提示工程师职业,究竟是昙花一现,还是长期需求,抑或会融合到算法工程师的技能体系内,还是未知数。

唯一可以确定的是,就像AI Exchange的创始人Rachel Woods所说,未来的真正工作技能,是“AI素养”。随着Prompt工具的平民化,每个人都能掌握这一技能。

而盲目转行,恐怕还没站上风口、长出翅膀,就要面临风停的考验。

评论